21/04/2020

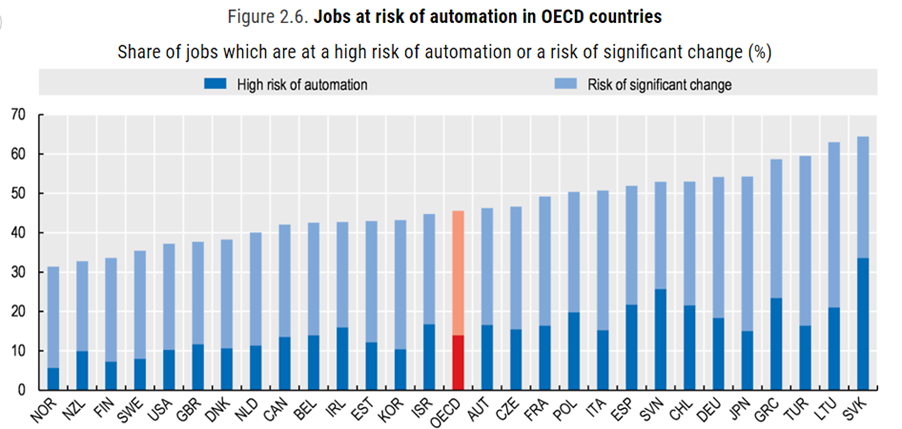

Según un informe de la OCDE, el 14 % de los trabajos en el mundo podrían estar afectados por la irrupción de la Inteligencia Artificial. El porcentaje es algo mayor en España, hasta un 22%, aunque en líneas generales es menor de lo que se esperaba. No todos los empleos pueden ser sustituidos, porque no siempre va a ser posible o eficiente.

Con todo, serán miles los empleos que sean sustituidos o modificados por robots y eso implica, que, como explicó Juan Ignacio Rouyet en la última edición de Las mañanas del Mañana, debamos ser conscientes de los riesgos que ya entrañan estas tecnologías y tener preparadas las respuestas para minimizarlos y gestionarlos con la máxima eficacia.

El director de Delivery de Quint fue el último invitado en los coloquios-desayuno organizados por DigitalES –ahora por streaming- y cifró en siete los riesgos que conviene identificar y combatir derivados de la adopción masiva de la Inteligencia Artificial. Hacerlo de manera inteligente y ética determinará, a su juicio, el éxito en la implantación de estas tecnologías.

- Impacto en el comportamiento

El primer ejemplo lo vemos ya a diario en muchas casas. Los niños tratan sin educación a los asistentes virtuales, ya que Alexa o Siri obedecen sin necesidad de pedirles las cosas por favor. El riesgo estriba en que los niños puedan trasladar estos comportamientos a su relación con las personas, algo que, como advierte este artículo del Washington Post, ya está empezando a suceder. Niños más curiosos pero menos educados.

- Estupidez artificial

Cada vez es más difícil engañar a las máquinas. Pero es posible hacerlo. “Nos imaginamos que hay un pequeño cerebro humano dentro del ordenador, pero no, solo es programación y matemáticas”, explica Meredith Broussard, autora del libro Estupidez Artificial. No son infalibles: hay técnicas de maquillaje y vestuario para engañar a los sistemas de reconocimiento facial.

Según explicó Rouyet, se debe trabajar aún para lograr una Inteligencia Artificial completamente eficiente.

- Sesgo y falta de neutralidad de las máquinas

El sistema de inteligencia artificial que usan los jueces en EE UU como asesor tiene un sesgo y tiende a desaconsejar la libertad a los ciudadanos negros más a menudo que a los blancos. El algoritmo analiza 173 variables —ninguna de ellas es la raza— y da una probabilidad de reincidencia de 0 al 10. El problema no es tanto la máquina, sino el riesgo de que el juez delegue en ella.

- Seguridad de la Inteligencia Artificial

El video en el Barack Obama insultaba a Donald Trump se volvió viral hace un tiempo en Estados Unidos. Y sin embargo, era totalmente falso. La Inteligencia Artificial puede convertirse en un gran aliado para fabricar fake news si no la empleamos con la ética apropiada.

En este caso concreto, el vídeo es una creación de FakeApp, con la ayuda de Adobe After Effects. Este software usa aprendizaje automático para escanear las caras de las personas en un vídeo, y suplantarlas.

https://www.youtube.com/watch?time_continue=13&v=cQ54GDm1eL0&feature=emb_logo

- Consecuencias no intencionadas

En julio de 2017 saltaron todas las alarmas. Dos chatbots de Facebook habían desarrollado un lenguaje propio que no entendían sus programadores.

Fue sin embargo un simple error de programación. Ramón López de Mántaras, experto en inteligencia artificial del CSIC, sostiene que ninguna máquina tiene intenciones ni las tendrán nunca. “Pueden enseñarse a sí mismas a jugar al Go y derrotar a un campeón, pero no saben que están jugando. Si pusiésemos a esa misma máquina a distinguir fotos de perros y gatos olvidaría todo lo anterior. Solo pueden hacer una cosa a la vez”.

- Impacto en el empleo

Juan Ignacio Rouyet cifró el impacto en un 14% a nivel mundial y subrayó que la implantación de la Inteligencia Artificial no siempre es posible ni deseable, ya sea por cuestiones de eficiencia, ética o legalidad.

- Derechos de los robots

Por último, el también presidente del Think Tank “We the Humans” aseveró que los robots no deben tener derechos, porque tampoco tienen responsabilidades. “A día de hoy un robot no es libre, por tanto no debe responder ante nadie. Son las personas que están detrás de un sistema inteligente quienes deberán responder llegado el caso”, dijo.

Charla completa disponible en este vídeo: