25/10/2021

¿Considerarías inteligente a alguien que no sabe argumentar sus decisiones? ¿Te fiarías de que un algoritmo bajase o subiese tu hipoteca, te contratase o te despidiese si no es capaz de explicar por qué lo ha hecho?

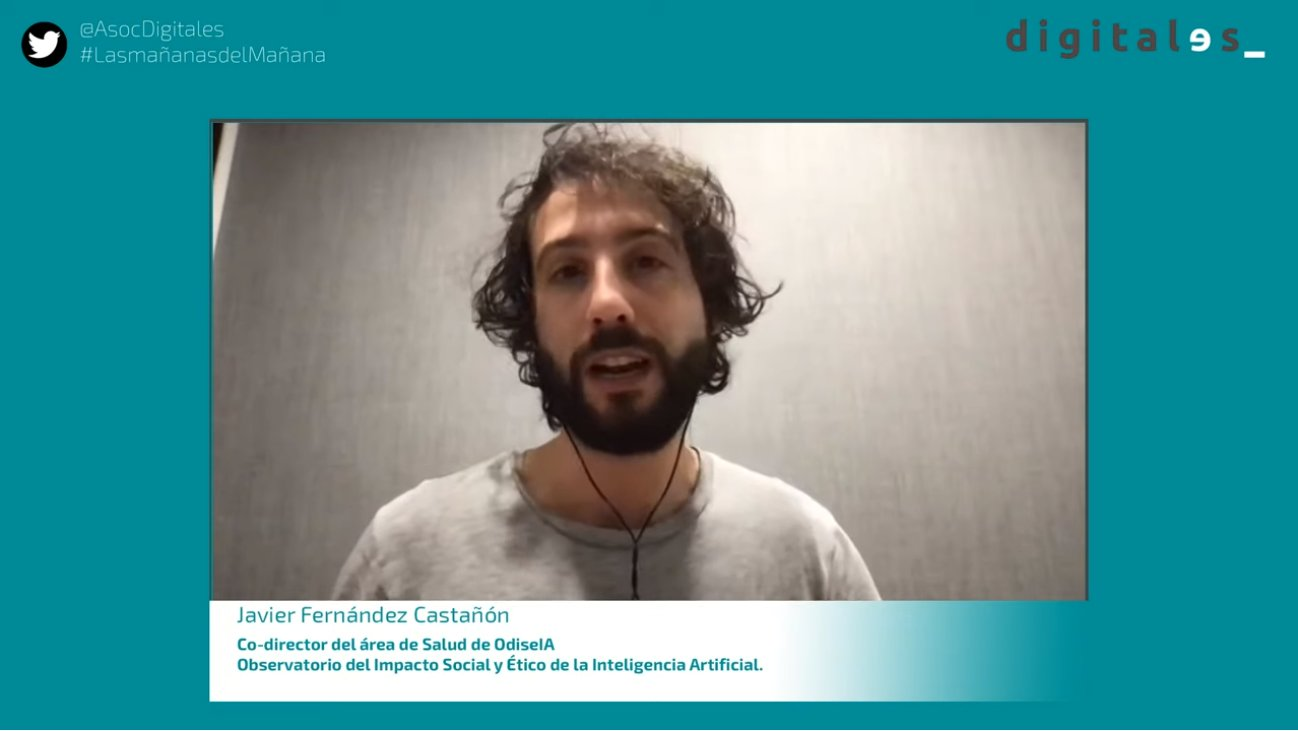

Con esta preguntas, Javier Fernández Castañón, co-director del área de Salud de OdiseIA, trató de hacer reflexionar a los asistentes a una nueva edición de ‘Las mañanas del Mañana’ sobre la importancia de la explicabilidad en el funcionamiento la Inteligencia Artificial.

En el coloquio-desayuno organizado por Digitales, el experto en IA insistió en que la única manera en la que podemos aceptar decisión tomada por una máquina (una hipoteca, una multa, etc) es cuando ésta es capaz de justificarla. Al igual que le pediríamos una persona, un algoritmo va a tener que dar respuestas si queremos que la sociedad acepte masivamente su uso.

En su opinión, la confianza va a ser clave en el desarrollo de una tecnología que no solo debe ser correcta, sino que también debe saber explicarse. “Igual que hace unos años se entendió cómo funcionaban los rayos X hay que hacer un esfuerzo por entender la Inteligencia Artificial. Hay que explicarla para que genere confianza”, dijo.

Fernández Castañón aseveró que las empresas desarrolladoras deberían publicar el grado de explicabilidad de la IA que facilitan, tal como hace IBM o la propia OdiseIA. “Eso genera confianza y transparencia, que se transforma en fidelidad. Además, entender el agoritmo va a permitir mejorarlo, y la innovación irá más rápido”, aseveró.

El experto en IA expresó también su creencia de que acabará existiendo un sistema de certificación de algoritmos a nivel europeo, un equivalente al certificado ecológico de colores de los edificios. A su juicio, ello daría más credibilidad a cualquier algoritmo que se emplease en la toma de decisiones.

7 principios éticos de la Inteligencia Artificial

En su exposición, habló también de los 7 principios éticos que debe seguir toda Inteligencia artificial: transparencia; privacidad; diversidad, equidad e igualdad; bienestar social y medioambiental; responsabilidad; supervisión humana y seguridad.

A pesar de ello, advirtió, “la IA acentuará todos los sesgos que nosotros podemos esconder de manera más sutil”. “Los superpoderes de los algoritmos empiezan a diluirse cuando los objetivos no son claramente cuantificables. Eso nos debe hacer pensar en nuestra ética como sociedad”, añadió.

“Las máquinas automatizarán todos los procesos que sean automatizables, y hay que ver cuál es la complementariedad del ser humano. Y ésa es pensar. Tener actitud crítica y tomar decisiones en la base a la información es trabajo de las personas”, concluyó.

Puedes volver a ver el desayuno completo pinchando aquí